Hace un par de años, cuando alguien hablaba de deepfake en una empresa, casi siempre estaba pensando en un caso muy concreto: el video trucado de un CEO, la voz clonada en una llamada al CFO. Era una preocupación de la dirección, atada a personas con visibilidad pública y con poder de firma. El resto de la organización podía seguir su día sin que el tema le ocupara demasiado lugar.

Ese mapa quedó viejo. La IA generativa pasó de ser un evento extraordinario a estar presente en flujos donde cualquiera de nosotros toma decisiones cotidianas: una contratación, una compra, una recomendación que viene de un perfil que parece confiable. Y nuestro reflejo, el viejo, sigue siendo el mismo. Si la imagen se ve impecable, asumimos que es real. Eso es exactamente lo que la nueva generación de fraudes aprendió a explotar.

¿Qué hacemos frente a este cambio? Lo primero que solemos hacer es lo más natural en formación corporativa, que es agregar un módulo más. Más artículos, más bullets, más explicaciones sobre cómo funciona la IA generativa. La persona termina sabiendo más sobre el tema, pero, llegado el momento de decidir, vuelve a confiar en lo que ve, lógico.

Lo que necesitamos entrenar es un reflejo

Acá hay un punto que conviene mirar con calma. Las personas tendemos a tomar decisiones rápidas, casi automáticas, cuando lo que tenemos delante parece familiar. Frente a una imagen perfecta, una voz reconocible o un perfil cuidado, avanzamos en piloto automático. Por eso, cuando el adversario controla la calidad de la imagen, la batalla por detectar lo falso con el ojo desnudo está perdida de antemano.

Lo que necesitamos instalar es otro hábito: la habilidad de no decidir nunca solo a partir de una imagen. Suena simple dicho así, pero es un cambio profundo en el comportamiento. Es poner un instante de duda donde antes había una confianza “ciega”. Y un reflejo de ese tipo no se cambia simplemente leyendo, sino que se cambia viviendo la equivocación una vez, en un entorno donde no cuesta nada equivocarse.

Todo empieza por el diagnóstico

Antes de proponerle nuevos hábitos a alguien, conviene saber qué hace hoy. ¿Cuando ve una foto de perfil en una red profesional, la amplía? ¿Hace una búsqueda inversa? ¿Frente a una oferta con descuento, lee la URL antes de hacer clic? ¿Ante una llamada inesperada de “su director” pidiéndole una transferencia urgente, confirma por otro canal antes de moverse?

Sin saber dónde está parada esta persona hoy, cualquier programa termina asumiendo un déficit que quizá no es el real. El diagnóstico inicial cumple esa función: mide el hábito para calibrar después el contenido sobre lo que efectivamente hace o no hace. Es una foto del punto de partida más que un cuestionario evaluativo.

Después, exponer

Una vez que sabemos cómo decide la persona hoy, el siguiente paso no es contarle más cosas. Es ponerla frente a una decisión, en un entorno seguro, y dejar que se equivoque. La equivocación vivida en primera persona logra instalar la duda donde antes había confianza automática.

A partir de ahí, sí llega la información sobre cómo funciona la IA, qué pasos de verificación tienen sentido y qué señales mirar. Pero esa información llega cuando la persona ya entendió, en su propio cuerpo, que su ojo no alcanza. Es muy distinto leerlo después de haberse equivocado que leerlo en frío.

El loop se cierra con la medición del reflejo

El final del recorrido no puede ser un certificado de “completó el módulo”. Tiene que ser una medición del reflejo nuevo: ¿ahora identifica las señales de alerta cuando aparecen?, ¿sabe qué hacer ante ellas?, ¿reporta? Comparada con el diagnóstico inicial, esa medición le da a quien lidera el programa algo más interesante que un porcentaje de finalización. Le da una curva de cambio, que es lo que termina importando.

¿Cómo se vive este ciclo desde la experiencia del colaborador?

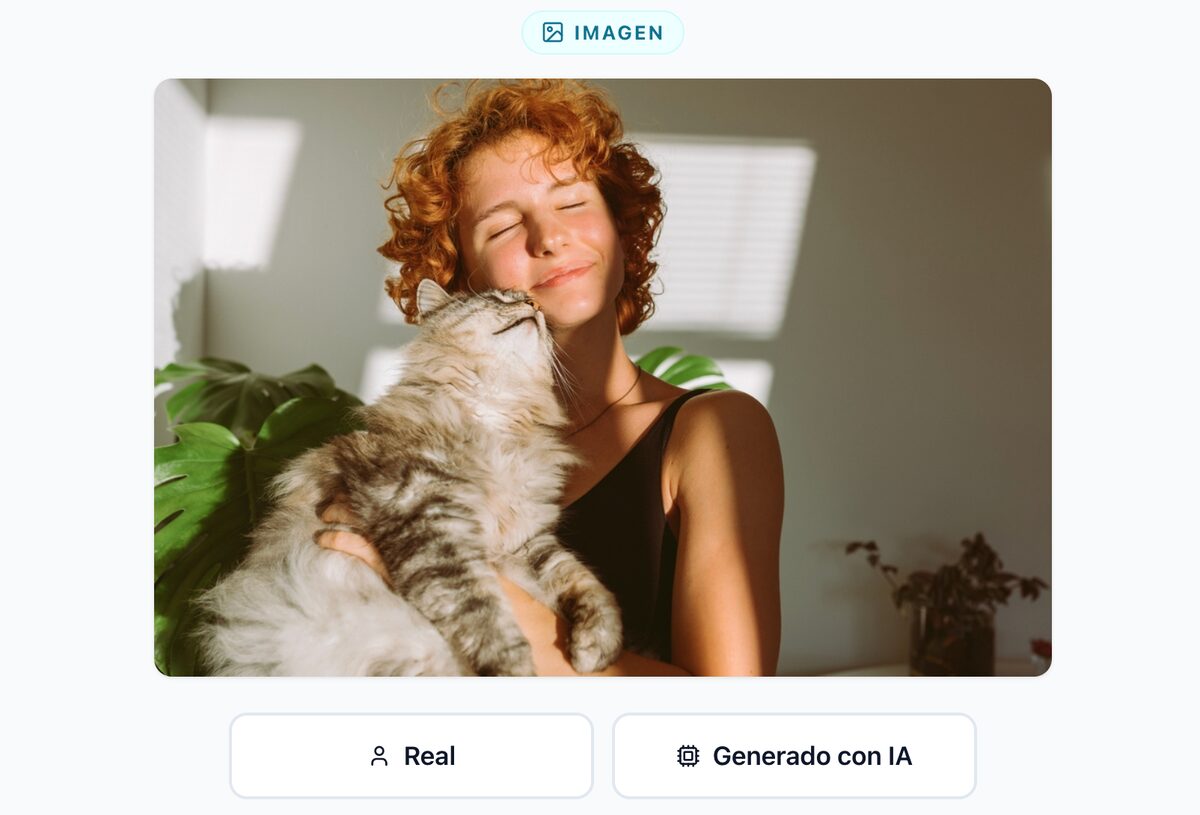

Hay un desafío muy simple que ilustra bien el efecto. Aparecen dos imágenes lado a lado y la consigna es elegir cuál fue generada con IA. La mayoría de las personas se equivoca. Esa única equivocación hace, de manera casi inmediata, lo que treinta minutos de teoría no logran: instala la duda donde antes había confianza plena.

En otra propuesta, la persona entra en una conversación que se va abriendo paso a paso. Cada respuesta abre o cierra puertas, comparte un dato y la conversación se mueve, lo retiene y se mueve hacia otro lado. Cuando termina, ve el panorama completo de lo que pasó, las decisiones que abrieron riesgo y las que lo cerraron. Lo que se aprende ahí se parece más a una sensación que a una regla. Cuándo una conversación empieza a “tirar” de uno y por dónde.

Y existe una versión más lúdica del mismo principio, llevada al formato de videojuego de pocos minutos, donde cada decisión tiene una consecuencia visible y feedback inmediato. En el tiempo que tomaría leer una infografía, la persona atraviesa varias equivocaciones controladas y empieza a registrar, sin darse cuenta del todo, el reflejo nuevo.

Concienciación que escala con la curva de la IA

Si algo nos enseñó este último tiempo es que la IA generativa no va a quedarse quieta esperando que el área de ciberseguridad la alcance. Cualquier indicador visible que aprendamos hoy puede quedar obsoleto en poco tiempo. Por eso, una formación que viva como un evento puntual al año pierde sentido. La concienciación funciona como infraestructura viva, sostenida en el tiempo y conectada al contexto donde el riesgo aparece.

Lo que no muta tan rápido es el reflejo. La costumbre de pausar, preguntar y verificar antes de decidir sigue funcionando aunque la imagen mejore, aunque la voz se afine, aunque el perfil del contacto se vea impecable. Y eso es lo que el método pedagógico apunta a entrenar, deepfake por deepfake, decisión por decisión.

Las señales están, solo hay que saber dónde mirar y qué preguntas hacerse. Si quieres ver cómo se está aplicando este enfoque a la familia de amenazas que abrió la IA generativa, te invitamos a conocer la plataforma y a conversar con nosotros sobre cómo se traduce a tu programa.

Deja un comentario